ADVERTISEMENT

GPT-4識圖功能遲遲不開放,終於有人忍不住自己動手做了一個。

MiniGPT-4來了,Demo開放線上可玩。

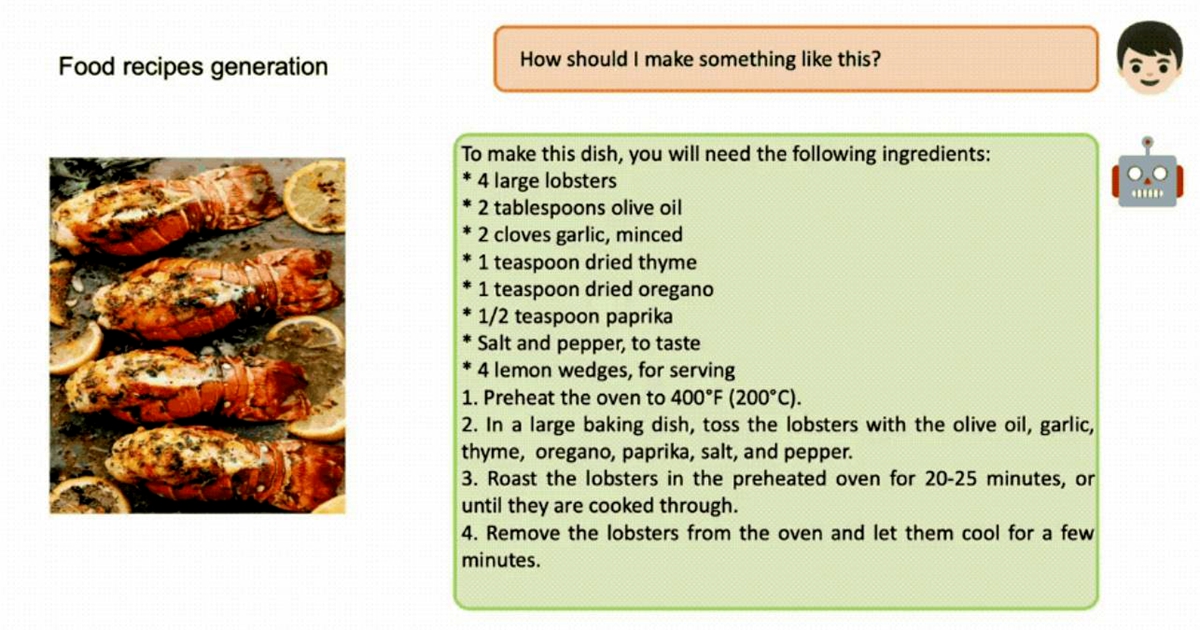

傳一張海鮮大餐照片上去,就能直接得到食譜。

傳一張商品效果圖,就可以讓AI寫一篇行銷文案。

手繪一個網頁,可以給出對應的HTML代碼

除了生產力滿滿,也支援根據常識推理圖上內容是否合理、解釋表情包為什麼好笑,以及看截圖找電影等娛樂玩法。

可以說,GPT-4發表時展示過的功能,MiniGPT-4基本也都有了。

這下網友直接把Demo伺服器擠爆,開發團隊連開4台備用伺服器,隨時都有幾十人在排隊。

不用等OpenAI了,現在就能玩

除了研究團隊給出的示例,網友也用MiniGPT-4玩出了各種花樣。

有人上傳自己畫的畫,讓AI評價看看。

有人上傳一張從車道拍攝的飛機墜毀瞬間,讓MiniGPT-4盡可能詳細地描述,並思考自動駕駛AI能不能理解這個場面。

做到這麼好的效果,MiniGPT-4實現起來卻並不複雜。

把圖像編碼器與開來源語言模型Vicuna整合起來,並且凍結了兩者的大部分參數,只需要訓練很少一部分。

傳統預訓練階段,使用4張A100在10個小時內就可完成,此時訓練出來的Vicuna已能夠理解圖像,但生成能力受到很大影響。

為解決這個問題,團隊讓MiniGPT-4與ChatGPT合作創建了3500個圖像文本的高品質資料集,也一併開源。

用新的資料集微調可以顯著提高模型的生成可靠性和整體可用性,而且運算效率很高,使用單個A100只需要7分鐘。

並且團隊正在準備一個更羽量級的版本,部署起來只需要23GB的VRAM。 也就是消費級顯示卡中擁有24GB VRAM的3090或4090就可以在本地端執行了。

MiniGPT-4開發團隊來自KAUST(沙烏地阿拉伯沙特阿卜杜拉國王科技大學),包括4位華人成員和他們的導師 Mohamed Elhoseiny。

兩位正在讀博的共同一作還在GitHub頁面上特別標注正在找工作。

- 線上Demo:https://minigpt-4.github.io

- 開源程式碼:https://github.com/Vision-CAIR/MiniGPT-4

- 論文連結:https://github.com/Vision-CAIR/MiniGPT-4/blob/main/MiniGPT_4.pdf

請注意!留言要自負法律責任,相關案例層出不窮,請慎重發文!