ADVERTISEMENT

制約 AI 人工智慧發展最大的桎梏是什麼?如在幾年前,這個答案可能五花八門。但在大模型盛行的當下,這個問題只有一個答案——算力不夠!

或者,換句話說,NVIDIA專用的 AI 算力晶片不夠。

誰控制了NVIDIA的 AI 晶片,誰就控制了 AI 的未來。

現在,有這麼一家公司,手中掌握了成千上萬塊NVIDIA的 AI「算卡」,客戶涵蓋了 OpenAI、微軟等眾多 AI 巨頭。

作為「AI 算力黃牛」,這家名為 CoreWeave 的公司,在 4 年時間就將公司估值做到了 80 億美元。拿到NVIDIA的獨家投資之外,CoreWeave 還以手中的NVIDIA晶片做抵押,從黑石 Blackstone、Coatue 等頂級機構獲得了 23 億美元的債務融資。

沒什麼能阻擋 CoreWeave 的瘋狂擴張,它到底是怎麼搞定NVIDIA、從一家加密幣「挖礦」公司,搖身一變成為 AI「算力基礎建設」巨頭的?

從「礦卡」到「算卡」

CoreWeave 的初創團隊由三人組成,分別是 Michael Intrator,Brian Venturo 和 Brannin McBee,三人最初在金融領域工作,經營過對沖基金、家族辦公室。

當年他們還在紐約管理基金時,加密貨幣挖礦熱潮還未消退,最初只是為了賺取額外收入,他們購買了第一張 GPU,隨後越買越多,華爾街的辦公桌上堆滿了 GPU。

「2016 年,我們購買了我們的第一張 GPU,插上電源,將其放在了俯瞰東河的曼哈頓下城辦公室的撞球桌上,然後挖掘了以太坊網路上的第一個區塊。」CoreWeave 首席執行長 Michael Intrator,在一篇 2021 年的部落格文章中如此回憶道。

很快,在 2017 年,他們將副業正式變成了一家公司,公司名字最初與加密貨幣相關,後來才改名叫 CoreWeave。在選擇告別華爾街時,如同矽谷大佬都喜歡在車庫裡創業那樣,他們將 GPU 硬體搬進了一個車庫,不過這個車庫不在西海岸的矽谷,而是在東海岸的紐澤西郊區,屬於其中一名創始人的祖父。

在過去十年中,GPU 是加密貨幣、人工智慧技術熱潮的重要引擎。在 2018 年底,CoreWeave成為北美最大的以太坊礦工之一,手握超過五萬張 GPU,占以太坊網路的 1% 以上。

期間,幾人也開始瞭解到其他公司對 GPU 資源的渴求。他們同時認識到,在加密貨幣領域並無持久競爭優勢,因為市場競爭激烈,受電力價格影響大。

當 2018 年和 2019 年加密貨幣價格暴跌時,他們決定多元化經營,進入其他領域,這些領域比較穩定,但也需要大量 GPU 運算。他們關注人工智慧、媒體娛樂和生命科學三大領域,並從 2019 年起,專注於購買企業級 GPU 晶片組,構建專門的雲端基礎設施,圍繞NVIDIA的晶片調整業務。

隨著新業務步入正軌,以太坊挖礦業務漸漸邊緣化。轉型的決定證明是正確且幸運的,幾個創始人都沒有料想到即將到來的 AI 浪潮之熱,讓 CoreWeave 逐漸從一個小辦公室擴張成遍布全國的資料中心,以對應不斷膨脹的 AI 市場需求。

據其中一名創始人披露,2022 年,CoreWeave 收入約有 3 千萬美元,預計 2023 年將超過 5 億美元,增長超 10 倍,並且已經簽署了近 20 億美元的合約。今年宣布在德州投資 16 億美元建資料中心,並計畫在年底前擴展至 14 個資料中心。

AI 「電網」

在 CoreWeave 成立短短幾年後,用於 AI 的 GPU 成為了全球最寶貴的資產之一,就像伊隆·馬斯克等人調侃的,現在,購買 GPU 比買藥還難。隨著生成式 AI 點燃市場,對 GPU 的需求急劇增加,而 CoreWeave 正好位於為 AI 公司提供所需資源的有利位置。

作為一家雲端服務提供者,CoreWeave 提供高性能運算資源的租賃服務,主要面向需要大量算力的客戶,模式是基礎設施即服務,按小時出租 GPU,客戶只需要按使用時間和運算資源量來支付費用,大客戶還有定制設施,旗號是「比傳統雲端提供商快 35 倍,成本低 80%,延遲低 50%」。該公司專注於高性能運算服務,而不像一般雲端服務商還提供儲存、網路等多種服務。

去年,就在 Stable Diffusion 和 Midjourney 等發布之際,CoreWeave 的高階管理人員們購買了大量NVIDIA最新的晶片。後來見到 ChatGPT 發布,他們意識到這樣的投資遠遠不夠,這些人需要的 GPU 不僅僅是數千個,而是數百萬個。

他們將 CoreWeave 要做的事情形容為「為 AI 市場建立電力網絡」,並認為「如果這些東西不建成,那麼 AI 將無法擴展」。

CoreWeave 的首席戰略長 Brannin McBee 在一檔PODCAST中談到,去年底,所有超大規模運算公司加在一起,包括Amazon、Google、微軟、甲骨文,將 CoreWeave 也算進去,它們共計提供了大約 50 萬張 GPU,到今年年底,或許將接近 100 萬張。

在行業增長速度和利潤空間方面,他認為,AI 市場的需求可以拆解為訓練模型和執行推理任務兩個階段,目前訓練階段存在晶片供應短缺,而推理階段將是未來需求的主要增長點,也是真正的需求所在。

對於一家 AI 公司的一個模型而言,退出訓練階段後,在產品上市的前兩年內,商業化階段的推理執行至少需要百萬張 GPU,但全球 AI 基礎設施還不足以滿足這一需求,這將是一個長期的挑戰,至少需要再過兩年,GPU 供應短缺才可能開始緩解。

如今,投入 AI 領域的熱錢大部分都得用於雲端運算。今年 6 月,CNBC 曾報導稱微軟「已同意在未來多年內在初創公司 CoreWeave 的雲端運算基礎設施上可能花費數十億美元」。像 Inflection AI 這樣的明星 AI 初創公司,最近籌集了 13 億美元資金來建立大規模 GPU 集群,同時,該公司的選擇也是 CoreWeave。

抱緊NVIDIA大腿

今年 4 月,CoreWeave 完成 2.21 億美元 B 輪融資,投資者包含晶片製造商NVIDIA,以及前 GitHub CEO Nat Friedman 和前蘋果高階管理人員 Daniel Gross。一個月後,公司宣布獲得 2 億美元加投,該輪融資總額達到 4.21 億美元。

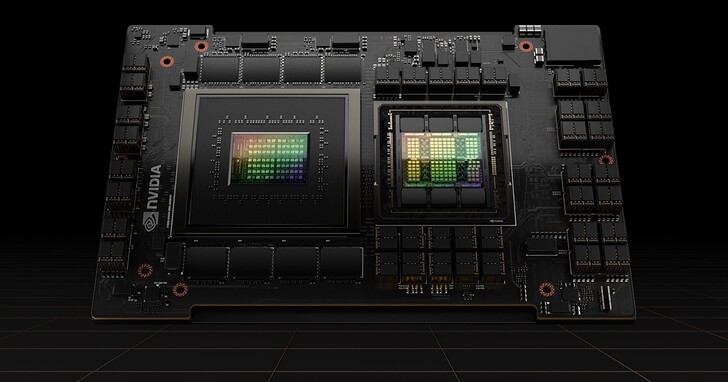

8 月,CoreWeave 又透過將高度搶手的NVIDIA H100 作為抵押品,獲得了另外 23 億美元的債務融資,資金將用於收購更多晶片,以及建設更多資料中心。

根據彭博最新消息,CoreWeave 目前正準備出售 10% 股權,其公司估值最高已經達到 80 億美元。

NVIDIA創始人黃仁勳今年在公司業績電話會議上稱:「你會看到一大批新的 GPU 專業化雲端服務提供者」「其中一個著名的就是 CoreWeave,他們做得非常出色。」

CoreWeave 與NVIDIA的聯絡在 2020 年已經開始,該公司當年宣布加入NVIDIA合作夥伴網路的雲端服務提供者計畫,主要目的是將 GPU 加速引入雲端中。在不久前的 2023 年 Siggraph 電腦圖形大會上,黃仁勳現身,CoreWeave 的每個展臺都特意用小字標明「由NVIDIA提供動力」。

包括黃仁勳在內,NVIDIA的高階管理人員們不吝於為 CoreWeave 露臉背書。

NVIDIA全球業務發展、雲端和戰略合作夥伴全球總監稱 CoreWeave 是「NVIDIA合作夥伴網路中的首個精英運算雲解決方案提供商。他們為客戶提供了廣泛的運算選項,從 A100 到 A40,以前所未有的規模,以及在人工智慧、機器學習、視覺效果等方面提供世界一流的結果。NVIDIA為 CoreWeave 感到自豪。」NVIDIA另一名高階管理人員則在融資聲明中將其定位為「性能最高、能源效率最高的運算平臺」。

這類讚譽也與NVIDIA自身利益相關。NVIDIA需要確保他們的運算終端使用者能夠以最高性能的方式,規模化地訪問他們的運算資源,就像新一代晶片發布後,客戶希望儘快獲得它們一樣。這也使他們不吝於宣傳與 CoreWeave 的合作,多發展一個忠誠的「下線」並沒有害處。

CoreWeave 正是在滿足NVIDIA的標準和要求方面進行建設,規模化運營,在新一代晶片發布後的幾個月內將其上線,而不是像傳統的超大規模運算公司可能需要數個季度的時間。這使 CoreWeave 在NVIDIA內部具有較高的存取權限。

Brannin McBee 稱「作為一家企業,這使我們在NVIDIA眼中贏得了信任,因為他們知道我們的基礎設施將比市場上任何其他公司更快地交付給客戶,而且以最高性能的配置交付。」

硬槓矽谷巨頭

然而,面對矽谷巨頭的競爭時,CoreWeave 如何自處?

從整個行業來看,CoreWeave 在 AI 基礎設施運營方面的競爭對手包括微軟、Google和Amazon等科技巨頭。

8 月底,Google雲端首席執行長 Thomas Kurian 在年度 Next 大會上稱,目前行業中超 50% 的 AI 初創公司,以及超過 70% 的生成式 AI 獨角獸都是Google雲端的客戶。

一個八十億美元估值的初創公司,如何避免被一堆破兆等級美元的巨頭碾壓?當下的答案在於:小公司自身的靈活性和業務聚焦,以及科技公司之間敏感的戰略格局。

CoreWeave 高階管理人員們喜歡打一個比方:「通用汽車可以製造電動汽車,但這並不意味著它成為了特斯拉。」他們認為,人工智慧提出了傳統雲平臺無法處理的挑戰,讓新興公司在被迫適應的老牌公司面前佔據優勢。

矽谷巨頭們如Amazon、Google、微軟宛如同航空母艦,每次調整方向時都需要更多時間空間。在其看來,他們需要時間來適應新的 AI 基礎設施構建方式,通常在最新晶片發布後需要一段時間才能提供規模化的造訪。現在人們更加關注構建超級電腦,需要在這些電腦之間進行高度協同的任務,資料輸送量更高,而巨頭們最主要的資源並非用在這裡。

「當這三家巨頭建立雲端服務時,他們是為了其用戶群中的數十萬,甚至數百萬所謂的通用用例提供服務,在這些區域中,裡面可能只有一小部分容量用於 GPU 運算。」CoreWeave 首席技術長 Brian Venturo 稱。

CoreWeave 自認其靈活性和專業性使其能夠在 AI 基礎設施領域脫穎而出,在性能和成本效益方面具有競爭優勢,更適用于 AI 應用。CoreWeave 的員工只有兩百多人,客戶的數量都比員工多,但他們與 Inflection AI 甚至 OpenAI 支持者微軟達成了協定,提供定制系統和更多配置的晶片,比為通用運算而配備的伺服器更高效。

目前在規模方面,CoreWeave 稱擁有超過 45000 個高階NVIDIA GPU,可按需使用。重要的不僅僅是數量,而在於提供的存取權限。在選擇方面,CoreWeave 聲稱保持業內最廣泛的NVIDIA GPU 選擇,以滿足各種運算需求。他們設計了「合適大小」的工作負載系統,聲稱「既不多,也不少:剛剛好」。

至於價格,CoreWeave 的旗號是「比競爭對手便宜 80%」。

另一方面,背後NVIDIA的決策也很關鍵。透過掌控稀缺的 GPU 資源,選擇供貨給誰,也會影響整個市場。儘管供應緊張,但NVIDIA為 CoreWeave 分配了大批最新的 AI 晶片,從包括 AWS 等頂級雲端服務提供者那裡分流供應。原因在於,這些公司正竭力自行研發 AI 晶片,以減少對NVIDIA的依賴。

CoreWeave 的高階管理人員持有這麼一個觀點:「不自己製造晶片絕對不是劣勢」,因為這有助於他們爭取從NVIDIA那裡獲得更多 GPU。畢竟,他們與NVIDIA不存在利益衝突,而胃口龐大的矽谷巨頭們可能就不是這樣了。

不過,科技巨頭畢竟還是NVIDIA的大客戶。今年 8 月底,黃仁勳現身Google雲端年度 Next 大會,宣布與Google的新合作,Google的 GPU 超級電腦 A3 VM 在 9 月將向市場推出,搭載的是NVIDIA的 H100 GPU。

另外,如果真的突然出現了一種新的晶片,性能可以比NVIDIA更好,或不遜色於它,那將給 CoreWeave 的業務產生什麼影響?

Brannin McBee 認為,同一晶片的壽命包括前兩到三年用於模型訓練,然後四到五年用於推理執行,短期內風險不大。而且,NVIDIA正努力建立硬體周圍的開放生態系統,以增加行業對其晶片技術的黏性,其他製造商顯然非常有動力進入這個領域,但他們缺乏生態系統,這是一個不可忽視的鴻溝。

在沒有硬核的晶片製造技術的情況下,CoreWeave 的相對優勢和成功,牢牢系于其合作夥伴的供應鏈和穩定性,在全行業 GPU 緊俏的時候,這種依賴就還是優勢。

從加密幣「礦場」到人工智慧「算力礦場」,CoreWeave 的發跡史令人咋舌——時代的一粒金沙,即便落到一個創業公司身上,也能讓其迅速崛起。在這個 AI 狂飆的時代,行業對於算力的渴望,成就了萬億美元的NVIDIA,顯然也成就了 CoreWeave 這樣能瞅準時機 All in 的公司。

> AI取代挖礦成為暖化及消滅人類最大元凶╯-__-)╯ ╩╩╮(╯_╰)╭(⊙ˍ⊙)囧rz

人類所有的活動都是在使地球生態產生變化,關鍵是…有沒有意義。

比起幾近毫無意義的礦幣,AI發展下去,至少是有前景的。