把 GPT-4+Dall-E 3 能⼒整合起來的模型該有多強?

香港中文大學終身教授賈佳亞團隊提出多模態模型 Mini-Gemini:更高解析圖像的精確理解、更高品質的訓練資料、更強的圖像解析推理能力,還能結合圖像推理和生成。

Mini-Gemini 還提供了 2B 到 34B 的超大模型,最強模型在多個指標上相比 Google 的 Gemini Pro 甚至 GPT-4V 都不遑多讓。

目前,Mini-Gemini 從程式碼、模型到資料已全部開源,登上了 PaperWithCode 熱榜。

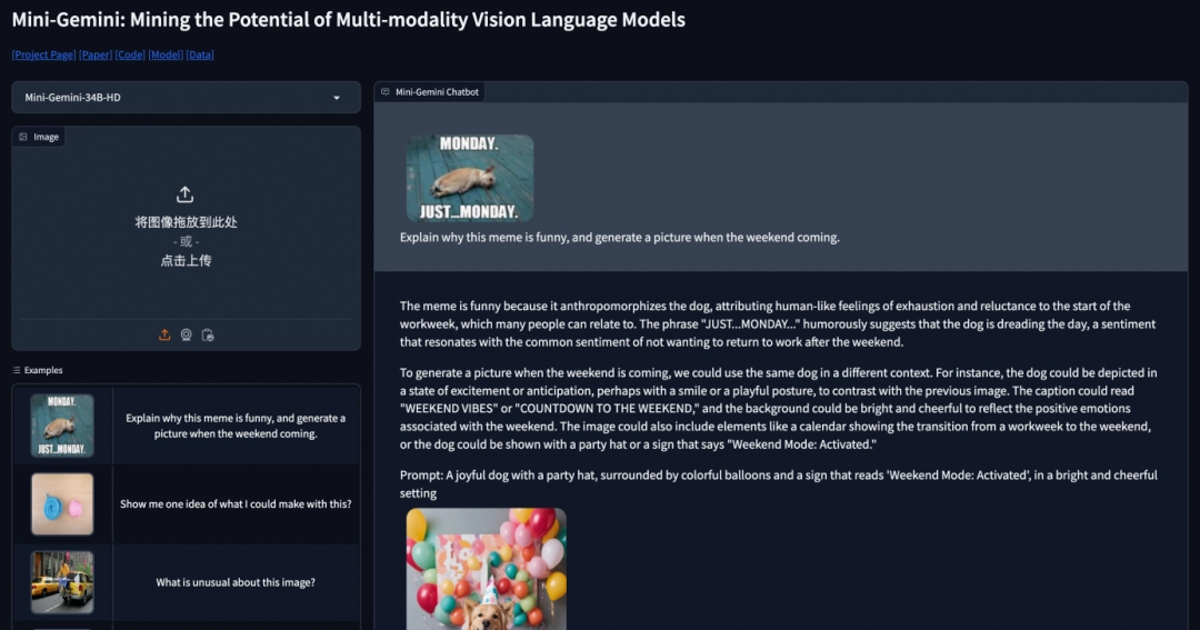

Mini-Gemini 線上 Demo 也已發佈,超會玩梗,一起來體驗下!

接近商業閉源模型水平

Mini-Gemini Demo 放出後受到廣大網友關注,一番“品嚐”後,他們認為 Mini-Gemini 跟商業模型差不了多少。

目前,絕大多數多模態模型僅支援低解析度圖像輸入和文字輸出,而在實際場景中,許多工都需要對高解析圖像進行解析,並用圖像的形式進行展現。

如下圖所示,Mini-Gemini 不僅能夠根據圖片對做面包的過程進行手把手教學,也能夠準確將不同電腦品種根據圖片中的各種參數進行對比。

有網友開玩笑說,這下媽媽不用擔心我獨自生活了。

更重要的是,Mini-Gemini 在保留超強的圖像理解和推理能力的同時,還解鎖了圖像的生成能力,就如同 ChatGPT 和生成模型的結合。

下面,讓我們通過幾個例子來更直觀地感受這種能力:

還記得 Google Gemini 的官方展示影片嗎?當使用者給出兩個毛線團並問出能用它們做什麼時,Gemini 可以識別出圖片內容並給出相應的建議。

當我們把相似的輸入給到 Mini-Gemini,它會怎麼回答呢?

可以發現,Mini-Gemini 也可以識別出圖片中的元素,並且合理地建議,同時生成了一隻對應的毛線小熊。

通過一些抽象的多模態指令來讓模型給出推理,並生成合適的圖片,這個操作就很像是 ChatGPT 和 DALL・E 3 的聯動了。

接下來讓 Mini-Gemini 做自己最擅長的推理和圖片理解,看看它表現:

比如理解圖片中的矛盾點並舉一反三 —— 輸入冰川中的仙人掌,它會解釋其中的矛盾並生成一張熱帶雨林中北極熊的圖片:

圖片呈現了仙人掌的典型棲息地與冰的存在之間的視覺矛盾,因為在沙漠環境中自然不會出現冰。這種矛盾的類似例子可能是一隻北極熊出現在熱帶雨林中,因為北極熊適應於寒冷、覆蓋著冰的環境,在炎熱潮濕的氣候中無法生存。這種並置創造了一個引人注目且超現實的視覺效果,挑戰觀眾的期待,並可能引發人們對氣候變化、環境適應或不同生態系統融合的思考。

同時,正如 ChatGPT+DALL・E 3 的夢幻結合一樣,Mini-Gemini 的“推理生成”功能還可以在多輪對話中通過簡單指令生成連環小故事。

比方說,讓它根據使用者輸入講一個貴族小老鼠的故事,Mini-Gemini 會根據前文的文字生成結果和使用者輸入進行推理,在保持一致性的情況下對圖片進行修改,使其更符合使用者的要求。

當然,Mini-Gemini 對於多模態模型的傳統技能圖表理解也不在話下。比方讓模型理解輸入曲線圖的數學意義(高斯分佈),並讓它使用程式碼復現這張圖,通過運行生成的程式碼,模型可以高品質地還原曲線圖,節省了復現的時間。

又或者讓 Mini-Gemini 理解梗圖,通過其強大的 OCR 和推理能力,也可以精準指出笑點。

在另一個案例中,Mini-Gemini 除了理解梗圖本身,甚至推測了製作者的深層意圖。

高解析複雜的多圖表理解和歸納也是小菜一碟,Mini-Gemini 直接秒變打工人效率提升的超級外掛。

技術細節:

那麼問題來了,Mini-Gemini 是怎樣做到這種驚豔的效果呢?

核心在於三點:

(1) 用於高解析圖像的雙編碼器機制

(2) 更高品質的資料

(3) 訓練階段結合生成模型資料拓展

大道至簡,Mini-Gemini 的整體思路並不複雜。其中的 Gemini(雙子座) 表達的是使用視覺雙分支的資訊挖掘(Mining-Info in Gemini)解決高解析圖像理解問題。

詳細來說,Mini-Gemini 將傳統所使用的 ViT 當做低解析度的 Query,而使用摺積網路(ConvNet)將高解析度的圖像編碼成 Key 和 Value。

使用 Transformer 中常用的 Attention 機制,來挖掘每個低解析度 Query 所對應的高解析度區域。從而在保持最終視覺 Token 數目不變的情況下去提升對高解析圖像的響應,保證了在大型語言模型(LLM)中對於高解析圖像的高效編碼。

值得一提的是,由於高解析度分支摺積網路的使用,可以根據需要對圖像所需的解析度自適應調整。對於圖像的生成部分,Mini-Gemini 借助了 SDXL,使用 LLM 推理後所生成的文字連結兩個模型,類似於 DALL・E 3 的流程。

對於資料,Mini-Gemini 進一步收集並最佳化了訓練資料的品質,並加入了跟生成模型結合的文字資料進行訓練。在僅使用 2-3M 資料的情況下,實現了對圖像理解、推理和生成的統一流程。

Mini-Gemini 在各種 Zero-shot 的榜單上毫不遜色於各種大廠用大量資料訓練出來的模型。

量化指標:

可以看出,Mini-Gemini 提供了多種普通和高解析版本的模型,各個版本都取得了相似參數量下領先的效果,在許多指標上甚至超越 Gemini Pro 和 GPT-4V。

線上可玩:

值得一提的是,Mini-Gemini 的圖像理解和生成能力已經出了 Demo,可以線上跟自訂圖像對話的那種。

操作也極其簡單,直接跟輸入圖像或文字進行對話即可,歡迎來撩!

稿源:量子位

- 延伸閱讀:透過LM Studio大型語言模型軟體套件在AMD筆電跑LLM,效能還贏對手17%

- 延伸閱讀:你會跟ChatGPT說「請」嗎?研究顯示對LLM有禮貌可以提高其性能,難道AI理解人類的情感了?

請注意!留言要自負法律責任,相關案例層出不窮,請慎重發文!