Facebook的演算法之一,會根據你對臉書動態按讚的內容,來計算未來要「餵」給你的臉書動態哪些東西。Wired網站的編輯Mat Honan就做了一個實驗,他決定將臉書上所有看到的內容,就算是廣告也都給他按讚下去,想試試看會對他的臉書造成什麼影響。

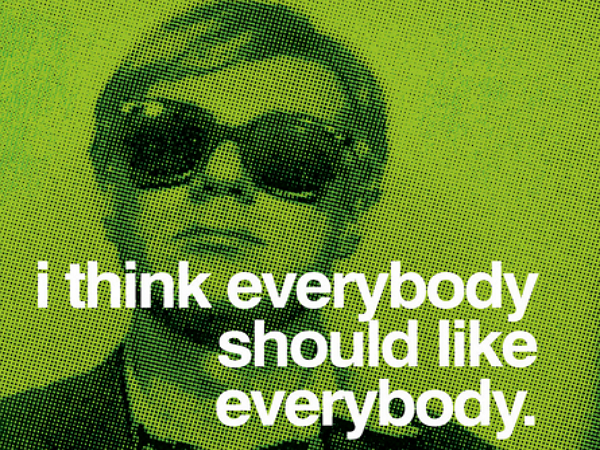

Mat Honan引用普普藝術大師Andy Warhol 的一句名言:「I think everybody should like everybody.」這句話帶給了他一個靈感,當面對臉書上的所有「Like」,他是不是也應該無私地去都給他們一個「Like」呢?

正如前面所說的,Facebook的演算法根據你按讚(Like)的內容會調整,當你將所有的內容都按讚,就是在加強機器人對於那些內容的推薦。但是,當你向機器人推薦了所有的內容,又會變得怎麼樣?

Mat按了哪些讚?

首先,Mat先是在他朋友的幾則消息上面按了讚,這裡跟他平常做的事情沒有什麼不一樣。接下來看到了幾個他朋友的朋友貼的連結:不好笑的笑話。以前他是不喜歡這種貼文的,但他依然按了讚。然後當他按下讚後,他發現問題又來了:Facebook的相關連結跳出來了。

Facebook的新演算法有時會根據你按的讚,再推薦給你一些相關文章。由於Mat按了一個他討厭的笑話一個讚,Facebook又跳出了四個跟那個笑話關鍵自有關得文章連結。於是,Mat又對四個他不感興趣的文章按了讚。

但是他發現當他對四個不感興趣的文章按下讚之後,馬上又延伸出新的四個,四個之後又是四個,他發現他陷入了「相關」迴圈,會沒完沒了的按下去。於是,Mat被迫設定了新規則:他只對第一次顯示的四個相關文章按讚,之後的全部忽略。

再來是一些新聞推薦,他按讚了,Amazon的優惠訊息,他也按讚了......

僅僅一個小時之後,他發現他的臉書上的動態已經「煥然一新」。他的臉書上再也沒有朋友、或是朋友的朋友的訊息出現。有的內容只剩下品牌推廣以及廣告訊息,再來就是一些新聞或是貼圖網站的訊息。當天晚上他睡前看自己的臉書動態,這種情況只變得更多,沒有朋友的訊息,都是新聞網站的消息。

在臨睡前,他又想到,自己該對一些加薩戰爭的消息按讚,於是他點了一條內容是支持以色列的新聞。

第二天早上醒來,他發現自己的臉書內容成為極右派。現在他的臉書跑出了第二修正案、反移民法案的相關訊息。當然,他又持續對這些消息點讚。

行動端與桌面端內容是不同的

Mat在這個實驗中還發現,使用桌面端的程式,與使用行動端的程式,呈現動態內容會不大一樣。當他瘋狂按讚之後,廣告以及新聞的比例變得很重,在他的手機上他幾乎完全「失去了朋友」,看不到朋友的訊息。但是在電腦端,雖然廣告狀況依然嚴重,但他的朋友還是可以突破重圍,露出一些訊息。

這只證明了一件事:在手機上螢幕小,能閱讀的訊息有限,Facebook寧可你多看兩則廣告,也不願你浪費時間看你的好友訊息。

你該把訊息來源交給機器嗎?

Mat從這個小實驗中注意到,過去我們說媒體的「守門人」理論,媒體會決定大眾看到什麼東西,影響大眾的想法。但是現在守門人轉移到社群網站上,而社群的守門人機制就是這些演算法機器人。

你對一個訊息按了讚,這個機制會給你更多同樣觀點的文章,進而強化你原本的立場。也許你按第一個讚的時候,對一件事情還只是半信半疑,但是當後面四個、八個、十六個更多相關的文章出現後,你就成為堅貞的信徒。

影響的不只是自己

當Mat開始進行實驗時,他有預期到自己臉書的動態會變得亂七八糟。但是他沒想到的是,這個改變也影響了他朋友的臉書動態。他朋友的臉書上都是他按讚的訊息,一個朋友以為他的帳號被駭了,另一個朋友則說,自己的臉書上一個晚上也看不到朋友的訊息,只有「Honan likes」。

Mat已經結束了這個實驗。不過現在他的臉書動態上充滿了所有他不喜歡的東西。他表示,雖然是一個實驗,但是他對於他所作過的事情,一點也不「Like」。

來源:I Liked Everything I Saw on Facebook for Two Days. Here’s What It Did to Me

一切依賴演算法

出問題趕快推給演算法

這是自己的社交圈,還是FB幫你製造的社交圈?