以前AI繪圖有個問題,就是畫出來的內容不可控。你希望某個東西出現在特定的位置上,但是往往事情跟你想的不一樣。

現在,AI 繪畫完全可以做到隨說即有了!

這邊哈士奇,那邊牧羊犬,背景在下雪天。

啪嘰!一幅畫就這麼完成了。

這個最新 MultiDiffusion 模型框架,不管選的區域位置有多離譜,它都能給你畫出指定的東西來。

比如,你能看到大象和奶牛同框??

而且線上可試,親測大概 15 秒就能出,你甚至可以看到泰勒絲與愛因斯坦跨時空同框。

要知道以前 AI 繪圖最大的一個 bug 就是不可控,但現在人類擁有了更多的控制權。

總之就是,能夠想畫什麼就畫什麼,想往哪畫就往哪畫!

有網友趕緊上手試了試:Not Bad!

想往哪畫就往哪畫

從效果來看,主要有三個方面的應用。

-

文字到高解析度全景生成;

-

精確區域生成;

-

任意長寬比粗略區域生成。

首先,只需要一句話,就可以生成 512*4609 解析度的全景圖。

一張有滑雪者的雪山頂峰的照片。

攝影師也不用爬樓了,直接獲得城市夜景圖。

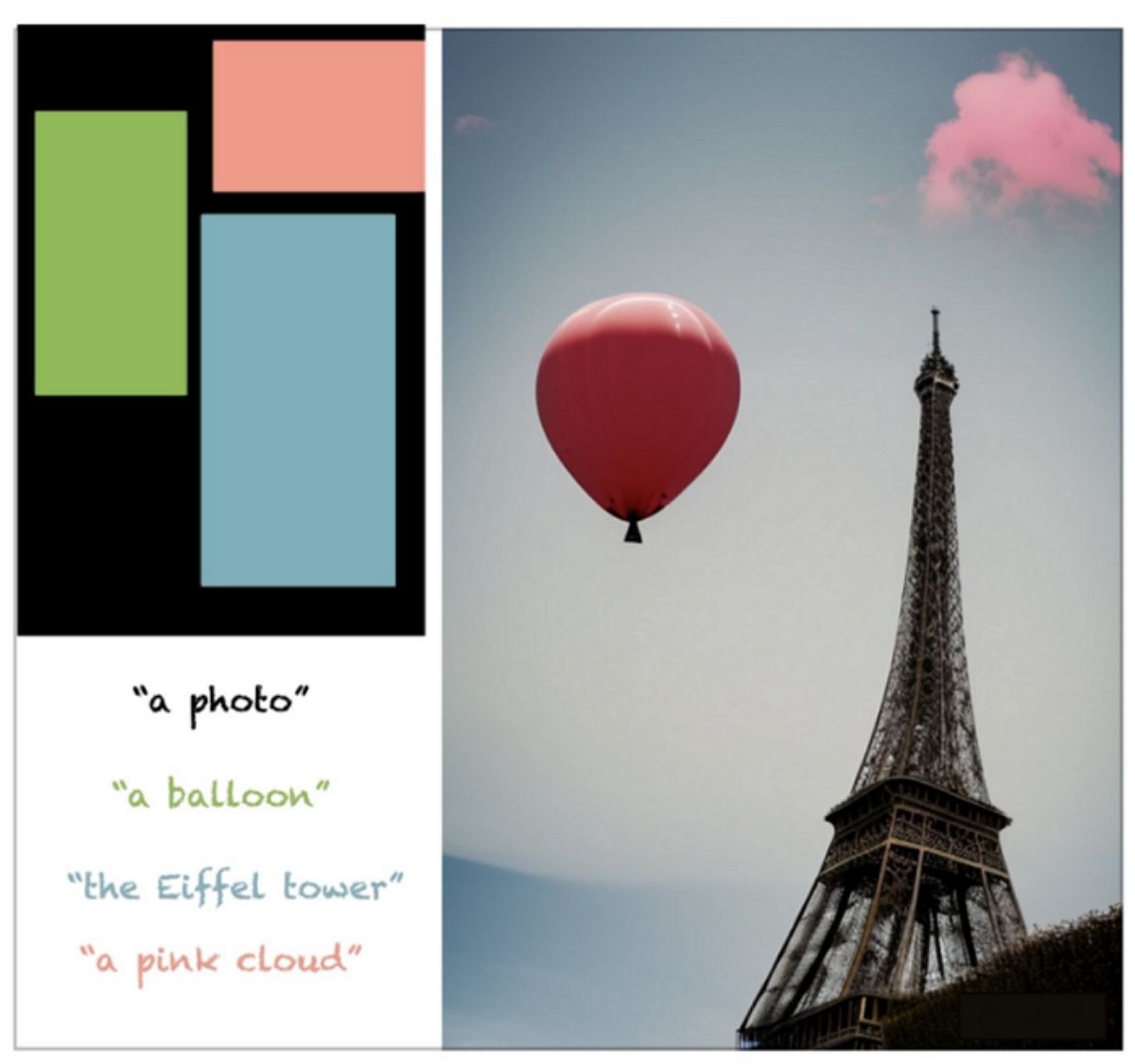

當然更為主體功能,那就是給特定區域單獨提示,然後 AI 繪畫就來指哪畫哪。

比如在黑色部分是一個明亮的盥洗室,紅色區域是一面鏡子、藍色部分是花瓶、黃色部分是白色的水槽。

就這麼隨手一個拼圖畫,結果就生成了真實場景。

不過也有一些 bug,像一些超現實的,他就有點太天馬行空了。

比如三體人在宇宙中大戰人類。

當然也可以無需那麼精確,只需標個大致位置,還支援任意長寬比的圖像。

關鍵是各種構圖都十分地合理、場景效果以及實際物體相對大小也都十分精準。

圖像生成可控

背後的這個模型叫做 MultiDiffusion,這是一個統一的框架,能實現多功能和可控的圖像生成。

以往即便 Diffusion 模型給圖像生成帶來變革性影響,但使用者對生成圖像的可控性、以對新任務的快速適應仍是不小的挑戰。

研究人員主要是通過重新訓練、微調,或者另外開發工具等方式來解決。就像前不久爆火外掛 ControlNet 正是解決了圖像生成的可控性,

而 MultiDiffusion 無需進一步訓練或微調,就可一次實現對生成內容的多種靈活控制,包括期望的長寬比、空間引導訊號等。

簡單來說,MultiDiffusion 的關鍵在於,在預先訓練好的擴散模型上定義一個全新的生成過程。從噪聲圖像開始,在每個生成步驟中,解決一個最佳化任務。

然後再將多個擴散生成過程與一組共享的參數或約束結合起來,目標是將每個部分都儘可能去接近去噪版本。

即便有時候每個步驟都可能會將圖像拉向不同的方向,但最終融合到一個全域去噪步驟當中,得到一個無縫圖像。

來自魏茨曼科學研究所

這篇論文主要來自位於以色列雷霍沃特的魏茨曼科學研究所。

兩位共同一作 Omer Bar-Tal、Lior Yariv 分別是魏茲曼科學研究院電腦科學和應用數學系的研究生和博士生,後兩位分別是他們的導師。

好了,感興趣的朋友可戳下方試一試哦!

https://huggingface.co/spaces/weizmannscience/MultiDiffusion

首頁連結:

https://multidiffusion.github.io/

論文連結:

https://arxiv.org/abs/2302.08113

請注意!留言要自負法律責任,相關案例層出不窮,請慎重發文!