據外媒報導,上週有研究人員開發出了一種可以實現超90%準確率的深度偽造(deepfakes)的檢測工具。令人欣慰的是,這可以減少部分由AI製作的贗品所帶來的危害程度。 然而專家們認為,這只能解決部分問題。

南加州大學電腦視覺專家兼副教授Hao Li告訴The Verge,任何深度偽造檢測器的有效期限,都只有一小段的時間。他表示,事實上,在某種程度上,可能根本無法檢測出AI贗品。

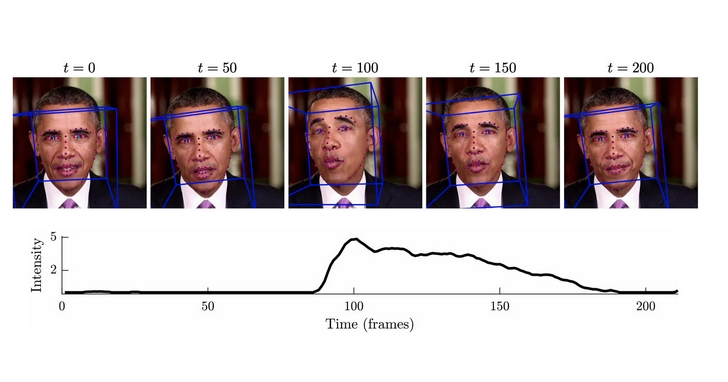

據悉,Li及其同事最近設計出了一套深度偽造檢測器。他們透過一套演算法追蹤每個人特有的臉部小動作然後辨別出假的影片。這些標記被稱為soft biometrics(輔助生物辨識),對於AI來說它們太過微妙以致目前還無法模仿。這些包括諸如在回答問題時如何撅起嘴巴、揚起眉毛等動作。最終試驗結果顯示,系統的準確率至少能達到92%。

不過,Li表示,系統的有效性不會持續太久,因為深度偽造技術正在以病毒/反病毒動態的方式發展。

例如,2018年6月的時候,研究人員發現,由於深度偽造系統沒有對人們閉眼的影片進行過訓練,所以他們製作了具有非自然眨眼模式的影片。結果AI複製眨眼的頻率並不高有時甚至不眨眼。而接下來,事態的發展多少是可以預測的。Li及其同事表示,在這項技術公開沒多久下一代的合成偽造技術就將眨眼融入了新系統中。

頗具諷刺意味的是,這種反覆的模仿生成了深層造假的核心技術:生成式對抗網路(GAN)。這是一種機器學習系統,由兩個神經網路組成協同工作。其中一個網路產生假的訊息,另一個則嘗試檢測出假訊息,然後內容會來回反彈並隨著每次攻擊而不斷改進。

人工智慧基金會(AI Foundation)研究副總裁Delip Rao也認為,挑戰遠不止開發檢測系統那麼簡單。例如,上週公佈的深度偽造檢測演算法的準確率高達97%,但正如Rao所指出的那樣,在考慮網路平台的規模時,3%也可能具有破壞性。Rao表示:「假設Facebook使用這種演算法、而且Facebook每天收到3.5億張左右的圖片,那就會有大量被錯誤辨識的圖片。」

Rao指出,開發出能夠辨識別深度偽造的技術雖然非常重要,但更大的挑戰是如何讓這些方法變得有用。

眼下,Rao及其在基金會的同事們正在研究一種結合人類判斷的方法,但其他人認為,驗證真影片和真圖像應該是起點,而不是尋找造假。為此,他們開發了可以自動加入浮水印和辨識出由相機拍攝的圖像的程式,不過其他人則建議使用區塊鏈技術來驗證內容。

然而不管怎樣,這些技術都不能真正解決深度造假的問題--只要網路以目前的形式存在這種情況就會繼續存在。

- 本文授權轉載自cnBeta

請注意!留言要自負法律責任,相關案例層出不窮,請慎重發文!