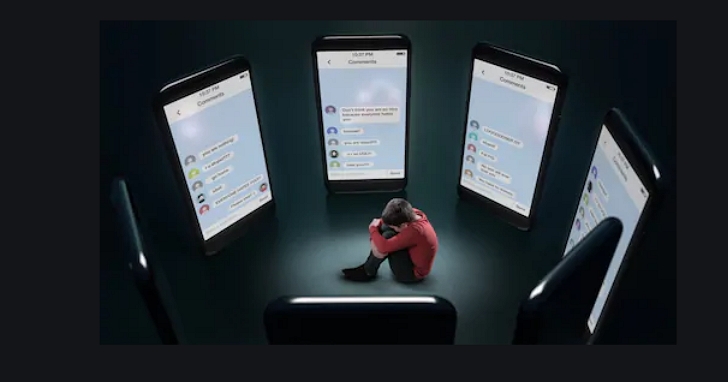

據TechCrunch報導,Instagram近日宣佈,針對旗下用戶即將發佈的照片或影片,如果偵測到包含潛在攻擊性的內容時,Instagram會向使用者發出警告,以減少帶有暴力辱罵文字的言語暴力。

這個功能是透過AI來實現的,是否該針對發文內容警告Instagram使用者,將由AI工具來判斷,如果AI工具認為用戶發的照片或影片的配文、字幕中帶有攻擊性的內容,判斷內容可能有害,則AI工具會產生一條通知,說明內容「看起來與已舉報的其他內容相似。」

不過,這個功能並沒有強制性,揪出霸凌內容後它將「建議」使用者編輯內容進行修改。不過,如果使用者覺得沒關係的話,它也不會制止,。使用者還是可以不加更改地發佈。

因此,充其量這個功能就是協助使用者在發文前「多想兩秒鐘」。

這項新功能建立在Instagram於7月份推出內含的AI工具為基礎來發佈,7月份發佈的這個AI工具專門用於使用者評論,可以檢測貼文評論區中,可能涉及霸凌或是侮辱的文字留言。該公司表示,這個工具促使人們重新考慮發表可能有害的留言,在該公司打擊線上霸凌行為中產生了有希望的結果。

Instagram表示,這項新功能目前正在「特定國家」推出,並且將在未來幾個月內在全球用戶進行部署。

- 本文轉載自pingwest

請注意!留言要自負法律責任,相關案例層出不窮,請慎重發文!